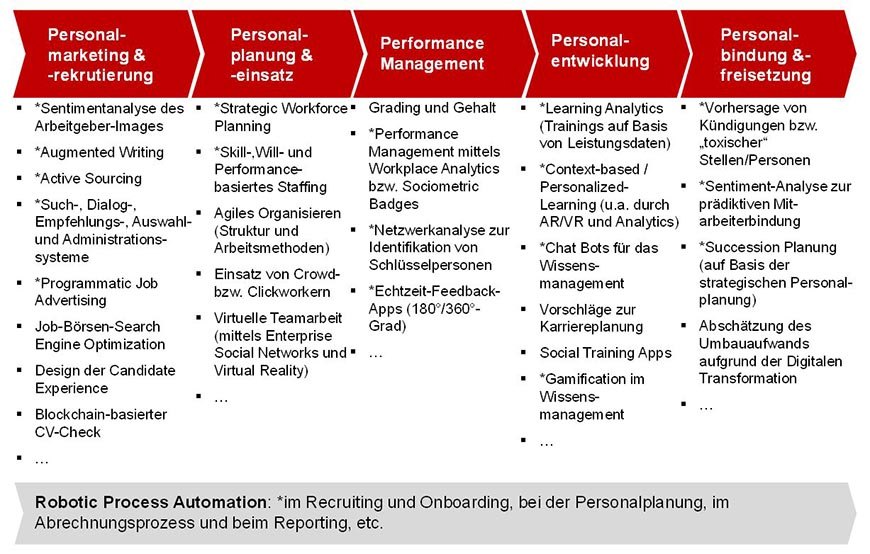

Es gibt sie, die digitalen Tools für Analytics und Automatisierung, die sich als nützlich für die Personalarbeit herausgestellt haben. Es gibt sogar dutzende entlang der HR-Wertkette (siehe Abbildung).

Was bringen digitale Tools? Chancen und Risiken

Fasst man die Chancen, die sich durch den Einsatz digitaler Tools für HR bieten, zusammen, so lauten sie: innovative Angebote, höhere Qualität, niedrigere Kosten – und insgesamt ein Sprechen in der Sprache des Managements, womit HR bei Entscheidungen ein gewichtiges Wörtchen mitreden kann.

Dem stehen Risiken gegenüber. Allen voran die Frage, was mit den personenbezogenen Daten geschieht, die gesammelt werden: Sind die gezogenen Schlussfolgerungen auf Basis der Daten im Sinne der Mitarbeiter oder ausschließlich im Interesse des Arbeitgebers? Sind die datenbasierten Entscheidungen besser, also vorurteilsfreier, effektiver, rationaler? Was ist, wenn Dritte die Daten in die Hände bekommen? Neben diesen wichtigen Fragen schwingt bei Automatisierung zusätzlich das Risiko des Jobverlustes mit.

Was wir brauchen? Spezifische Details statt Allgemeinplätze

Das Problem an solchen Chancen-Risiken-Aufzählungen ist: Pauschalurteile über digitale Tools bringen uns nicht weiter, weil sie im Recruiting andere Konsequenzen haben als in der Personalentwicklung oder der Personalverwaltung. Deshalb ist es wichtig, sich zunächst mit gängigen Technologien und Algorithmen auseinanderzusetzen und erst dann mit dem unterschiedlich gelagerten Einsatz entlang der HR-Wertkette. So versteht man, dass der mögliche Schaden, den einzelne Mitarbeiter erleiden können, unterschiedlich hoch einzustufen ist. Zum Beispiel richten Empfehlungsalgorithmen, die Mitarbeitern unpassende Lerninhalte vorschlagen, weniger Schaden an als solche, die manche Bewerber empfehlen und andere nicht. Wenn öffentlich zugängliche Daten wie etwa Stellenausschreibungen, Patentdaten oder Texte auf Arbeitgeberbewertungsplattformen ausgewertet werden, dann ist dies datenschutzrechtlich kein Problem. Verwendet man die gleichen digitalen Tools für die Analyse von Leistungsbeurteilungen oder Posts im Intranet, sieht es natürlich anders aus.

Wer trifft die besseren Entscheidungen: Mensch oder Maschine?

Zu dieser Frage gibt es mittlerweile Erkenntnisse aus der Forschung, insbesondere im Recruiting-Bereich. Zum Beispiel kommen zwei Studien zu dem Ergebnis, dass menschliche Recruiter schlechtere Entscheidungen treffen als Maschinen, die auf Basis von Lebenslauf-Analysen Bewerber zur Einstellung empfehlen (Hoffmann et al. 2017; Cowgill 2020). Bei Skillanalysen, die auf Textdaten beruhen (z.B. CVs, Patentanmeldungen, Protokolle von Mitarbeiterentwicklungsgesprächen) – decken Text-Mining-Verfahren Zusammenhänge auf, die für Personal(einsatz)planungen und Entwicklungsmaßnahmen genutzt werden können (Squires et al. 2017; Libuda & Fleischmann 2018). Solche Muster können Menschen nicht identifizieren, wenn die Anzahl an Daten zu hoch ist, oder wenn nicht-lineare Zusammenhänge vorliegen.

Auch auf Fragen der Verzerrung und Diskriminierung durch Algorithmen gibt es wissenschaftliche Antworten (Raghavan et al. 2020; Sánchez-Monedero et al. 2020). Manche Aspekte sind noch nicht geklärt, aber der Grundtenor ist, dass der Bias einer Maschine statistisch erfasst und deshalb gegengesteuert werden kann. Offen bleibt die Frage, wohin gesteuert werden soll, was also allgemein akzeptierte Werte, Normen, Kriterien und Ziele wären oder wie man jemals einen „Wechselkurs“ finden könnte, mit man Unterschiede gegeneinander aufrechnen könnte. Ein bekanntes Beispiel ist die sogenannte 4/5-Regel, eine US-amerikanische Norm für das Recruiting: Der Anteil ausgewählter Bewerber von Gruppen mit bestimmter Hautfarbe, Geschlecht, Alter, sexueller Orientierung etc. darf nicht kleiner als 4/5 der Gruppe mit der höchsten Selektionsrate sein. Aber wieso 80 Prozent und nicht 75 Prozent oder 85 Prozent? Könnten nicht auch Religion oder der Gesundheitszustand ein Merkmal für potenzielle Diskriminierung sein? Und warum sollten die Merkmale alle gleich gewichtet werden?

Diese Fragen wird auch die beste künstliche Intelligenz nicht lösen. Zumindest solange, wie sie keinen vergänglichen Körper, keinen (Überlebens-)Willen und keinen gesunden Menschenverstand hat. Denn das alles braucht es zur Lösung komplexer sozialer Probleme, indem sich Menschen kommunikativ, kreativ, rational und emotional miteinander auseinandersetzen. Deshalb werden die digitalen Tools auch den „human touch“ der Personalarbeit nicht komplett ersetzen oder überflüssig machen. Allerdings wird es in Zukunft anteilig weniger People-People in der Personalabteilung geben, denn die Data & Technology-People werden mehr und stiften auch einen Mehrwert.

Das Buch zum Thema

Smart HRM: Digitale Tools für die Personalarbeit

236 Seiten, 23 Abbildungen

ISBN 978-3-658-29430-4

Quellen:

Hoffman, M., Kahn, L. B., & Li, D. (2017). Discretion in hiring. The Quarterly Journal of Economics, 133(2), 765–800.

Cowgill, B. (2020). Bias and productivity in humans and machines. https://ssrn.com/abstract=3584916.

Libuda, I., & Fleischmann, F. (2018). Strategische Personalplanung und People Analytics. In K. Schwuchow & J. Gutmann (Hrsg.), HR-Trends 2019: Strategie, Digitalisierung, Diversität, Demografie (S. 233–243). Haufe Lexware.

Raghavan, M., Barocas, S., Kleinberg, J., & Levy, K. (2020). Mitigating bias in algorithmic hiring: Evaluating claims and practices. In: Proceedings of the 2020 Conference on Fairness, Accountability, and Transparency (pp. 469-481). ACM.

Squires, P., Kaufman, H. G., Togelius, J., & Jaramillo, C. M. (2017). A comparative sequence analysis of career paths among knowledge workers in a multinational bank. In: IEEE International Conference on Big Data (pp. 3604–3612). IEEE.

Sánchez-Monedero, J., Dencik, L., & Edwards, L. (2020). What does it mean to ’solve‘ the problem of discrimination in hiring? In: Proceedings of the 2020 Conference on Fairness, Accountability, and Transparency (pp. 458-468). ACM.